인더뉴스 이종현 기자ㅣLG AI연구원은 자체 개발한 생성형 AI '엑사원(EXAONE)'의 성능을 강화한 '엑사원 3.5'를 오픈소스로 공개했다고 9일 밝혔습니다.

이는 지난 8월 직전 모델인 '엑사원 3.0'이 공개된 지 4개월 만입니다.

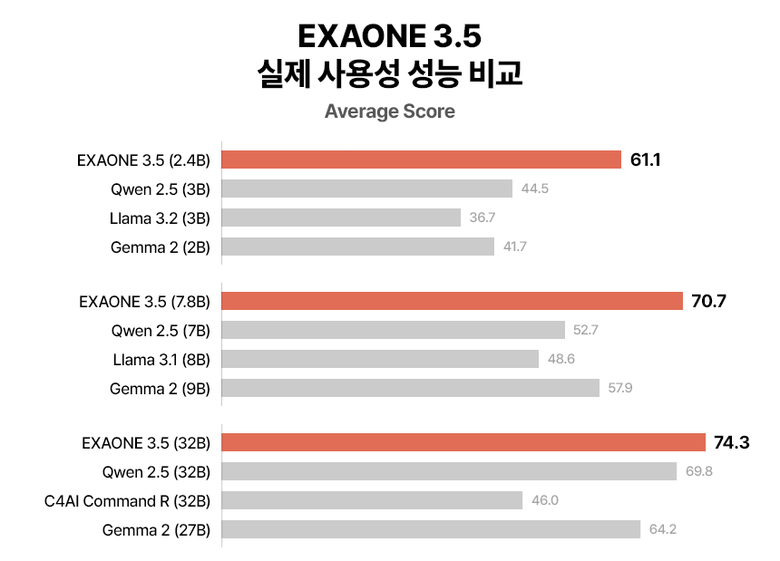

엑사원 3.5는 ▲온디바이스용 초경량 모델(2.4B, 24억 파라미터) ▲범용 목적의 경량 모델(7.8B, 78억 파라미터) ▲특화 분야에 활용할 수 있는 고성능 모델(32B, 320억 파라미터) 등 3종을 모두 오픈소스로 공개했습니다.

LG AI연구원은 환각 현상을 최소화하고 답변의 정확도를 높이기 위해 실시간 웹 검색 결과나 업로드한 문서를 기반으로 답변을 생성하는 검색 증강 생성 기술을 고도화하고 AI가 사용자가 입력한 질문을 단계별로 분해해 논리적으로 추론한 결과를 생성하는 기술을 적용했습니다.

LG AI연구원이 공개한 기술 보고서에 따르면 엑사원 3.5는 미국, 중국 등의 글로벌 오픈소스 AI 모델과의 성능 평가 비교에서 ▲실제 사용성 ▲장문 처리 능력 ▲코딩 ▲수학 등에서 세계 최고 수준이라는 설명입니다.

오픈소스로 공개한 엑사원 3.5는 3가지 모델 모두 연구 목적으로 활용이 가능합니다.

LG AI연구원은 엑사원을 기반으로 만든 기업용 AI 에이전트 '챗엑사원(ChatEXAONE)'의 정식 서비스를 개시하며 엑사원 3.5를 적용했습니다. LG 임직원들은 9일부터 전용 웹페이지에 접속해 가입하면 ‘챗엑사원’을 업무에 활용할 수 있습니다.

챗엑사원은 정보 암호화, 개인 정보 보호 기술을 적용해 임직원들이 사내 보안 환경 내에서 내부 데이터의 유출 우려 없이 업무에 활용할 수 있는 기업용 AI 에이전트입니다.

LG AI연구원은 챗엑사원에 엑사원 3.5를 적용하면서 성능을 고도화하고 '심층 분석(Deep)'과 '출처 선택(Dive)' 기능을 추가했습니다.

'심층 분석'은 여러 개의 질문이 섞여 있는 복합 질문을 했을 때 챗엑사원이 이를 단계별로 나눠 분석하고 추론한 뒤 종합적인 답변을 하는 기능이며 '출처 선택'은 범용, 해외 사이트, 학술 자료, 유튜브 등 검색 범위를 선택해서 목적에 따라 정확한 출처에 기반한 답변을 확인할 수 있는 기능입니다.

챗엑사원은 14개 직무, 133개 업무별 특화된 지시문을 추천하고 맞춤형 답변을 제공하며 임직원은 용도에 따라 관심 업무를 설정해 사용할 수 있습니다.

챗엑사원은 현재 한국어 기준으로 단어 2만개(영어 단어 2만3000개)를 동시에 처리할 수 있는 3만2000 토큰을 지원해 장문의 질문과 답변이 가능해졌고 내년 상반기 중 12만8000 토큰으로 확장될 계획입니다.

배경훈 LG AI연구원장은 "최근 생성형 인공지능 모델의 발전이 빨라져 업그레이드 속도전이 중요한 시기"라며 "산업 현장에 적용 가능한 초인공지능을 목표로 혁신의 속도를 높이고 한국을 대표하는 프론티어 모델로 발전시켜 나갈 것"이라고 말했습니다.